Der Februar 2026 wird als der Monat in die Geschichte eingehen, in dem die Grenzen zwischen „generativer KI“ und „echter Argumentation“ endgültig fielen. Während Google mit Gemini 3 Deep Think die lange unbezwingbare ARC-AGI-Mauer durchbricht, definieren chinesische Labore mit Minimax und Qwen die Ökonomie der Intelligenz neu. Gleichzeitig verlässt die KI den Bildschirm: Roboter tanzen mit Schwertern und Agenten laufen auf 10-Dollar-Hardware. Wir erleben keine Evolution mehr – es ist eine Explosion.

Die Rückkehr des Königs: Google Gemini 3 Deep Think

Lange Zeit wirkte es so, als hätte sich die Frontier-Modell-Entwicklung auf einem Plateau eingependelt. Doch diese Woche hat Google das Schweigen gebrochen und mit Gemini 3 Deep Think ein Modell veröffentlicht, das nicht nur inkrementelle Verbesserungen zeigt, sondern fundamental anders zu „denken“ scheint. Der Fokus liegt nicht mehr auf reiner Mustererkennung, sondern auf tiefer, emergenter Logik.

Der Fall der ARC-AGI-Mauer

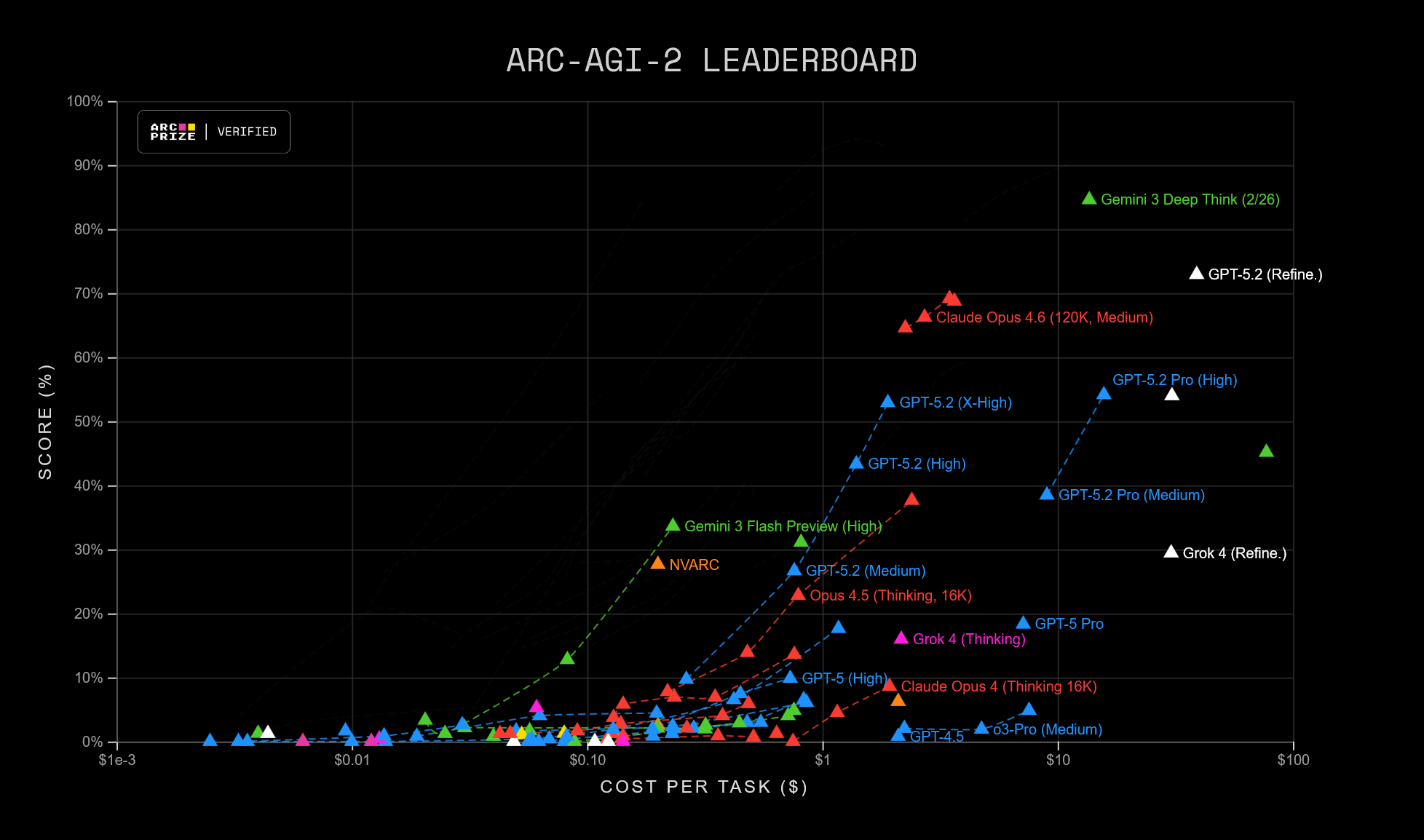

Der wohl schockierendste Datenpunkt dieser Woche ist der Score im ARC-AGI-2 Benchmark. Für diejenigen, die diesen Benchmark nicht kennen: Er gilt als der „Goldstandard“ für echte allgemeine künstliche Intelligenz (AGI). Im Gegensatz zu Tests wie dem MMLU, die oft durch pures Auswendiglernen von Trainingsdaten „gehackt“ werden können, erfordert ARC das Lösen neuartiger visueller Logikrätsel, die das Modell noch nie zuvor gesehen hat.

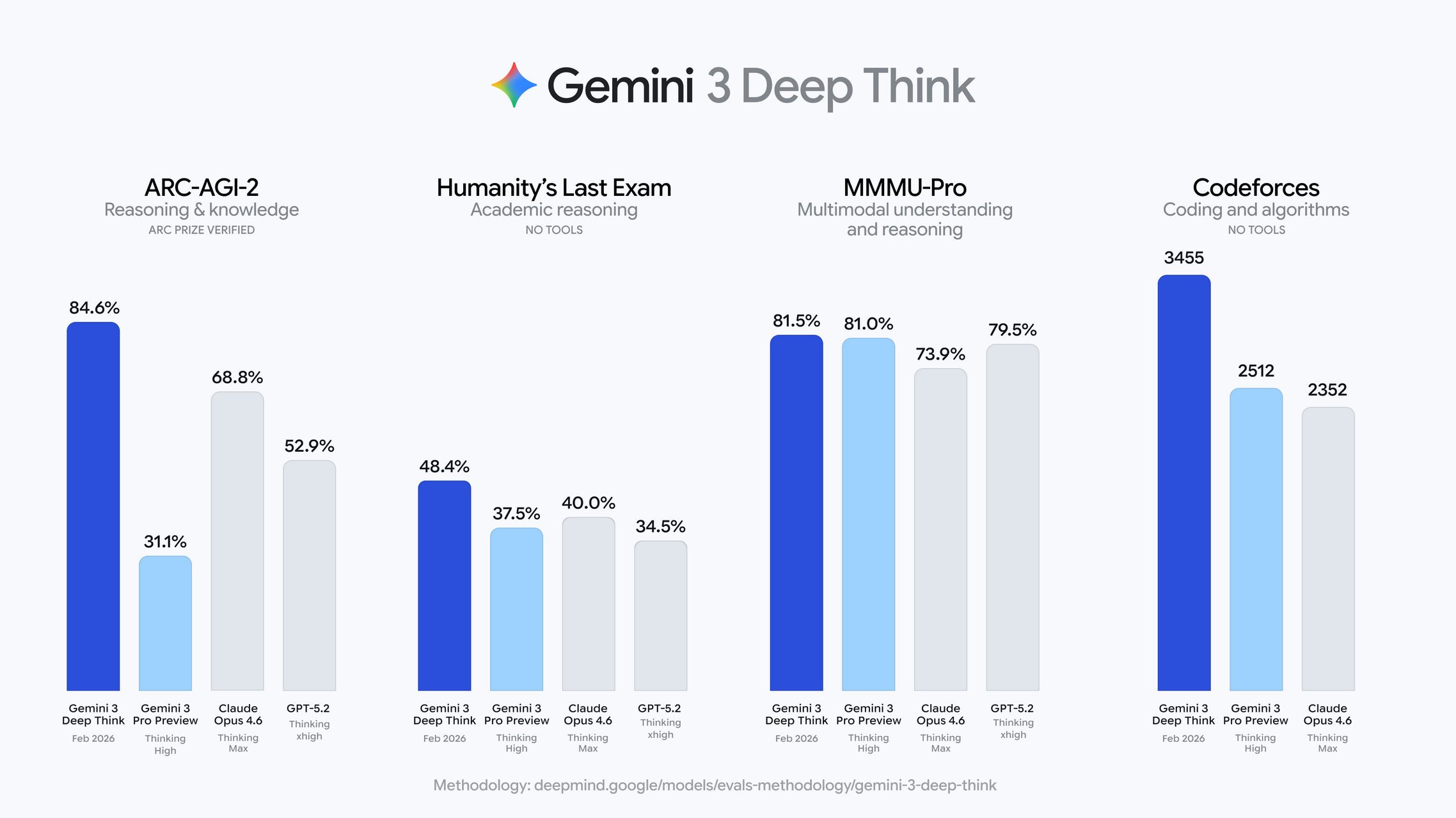

Wie die Charts zeigen, erreicht Gemini 3 Deep Think einen Score von 84,6 %. Zum Vergleich: Das bisher führende Modell, GPT-5.2 (Refine), lag bei etwa 73 %. Ein Sprung von über 10 Prozentpunkten in diesem Bereich ist kein linearer Fortschritt; es ist ein Beweis für emergentes Verhalten. Das Modell lernt während der Inferenzzeit neue Muster (In-Context Learning auf Steroiden).

In der Praxis bedeutet dies, dass wir uns von „Chatbots“, die lediglich statistisch wahrscheinliche Worte aneinanderreihen, hin zu „Reasoning Engines“ bewegen, die komplexe, mehrstufige Probleme in Wissenschaft und Forschung lösen können. Der Codeforces-Score von 3455 bestätigt dies eindrucksvoll – das Modell agiert auf dem Niveau der weltbesten menschlichen Wettkampf-Programmierer.

Qwen Image 2.0: Alibaba setzt neue visuelle Standards

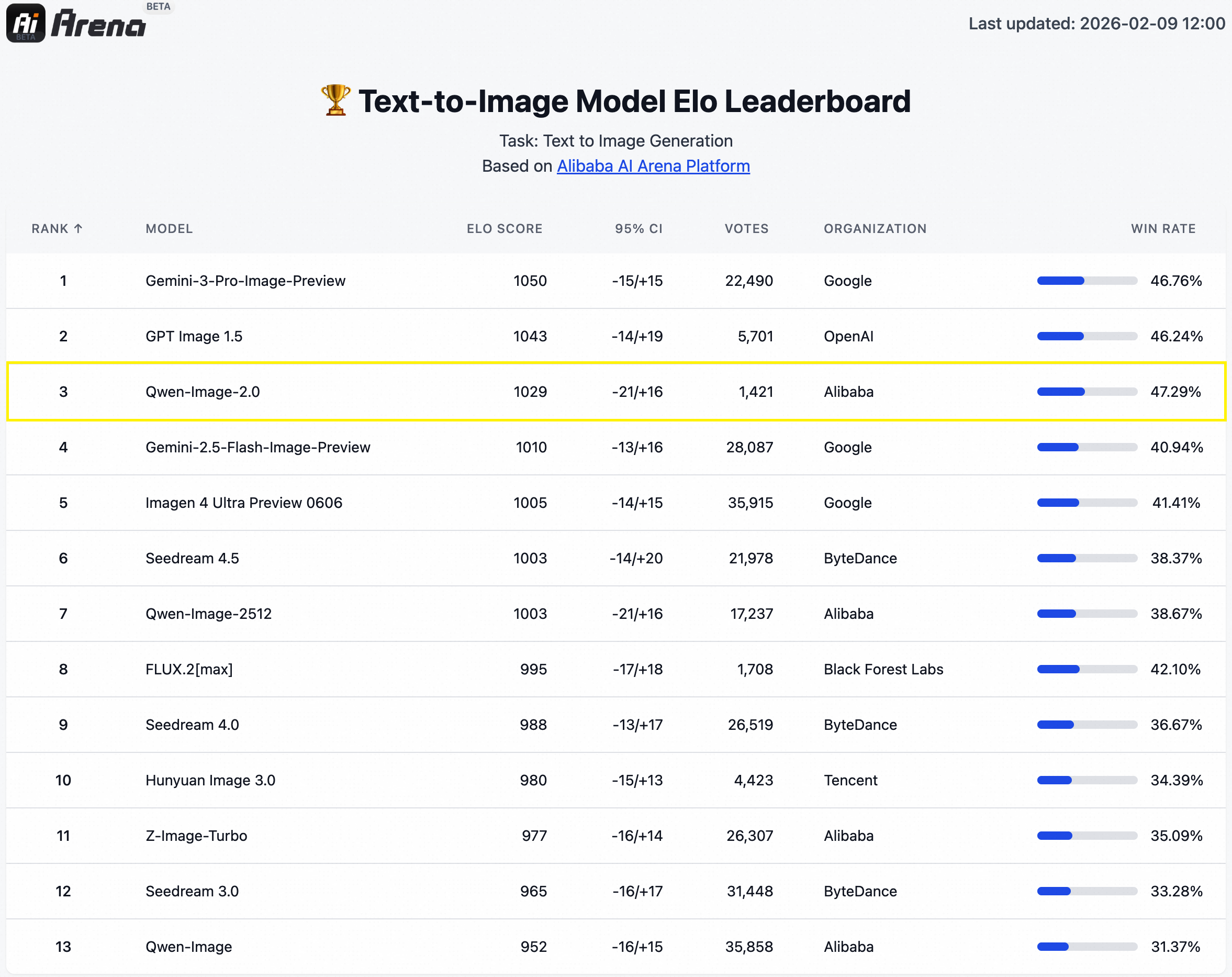

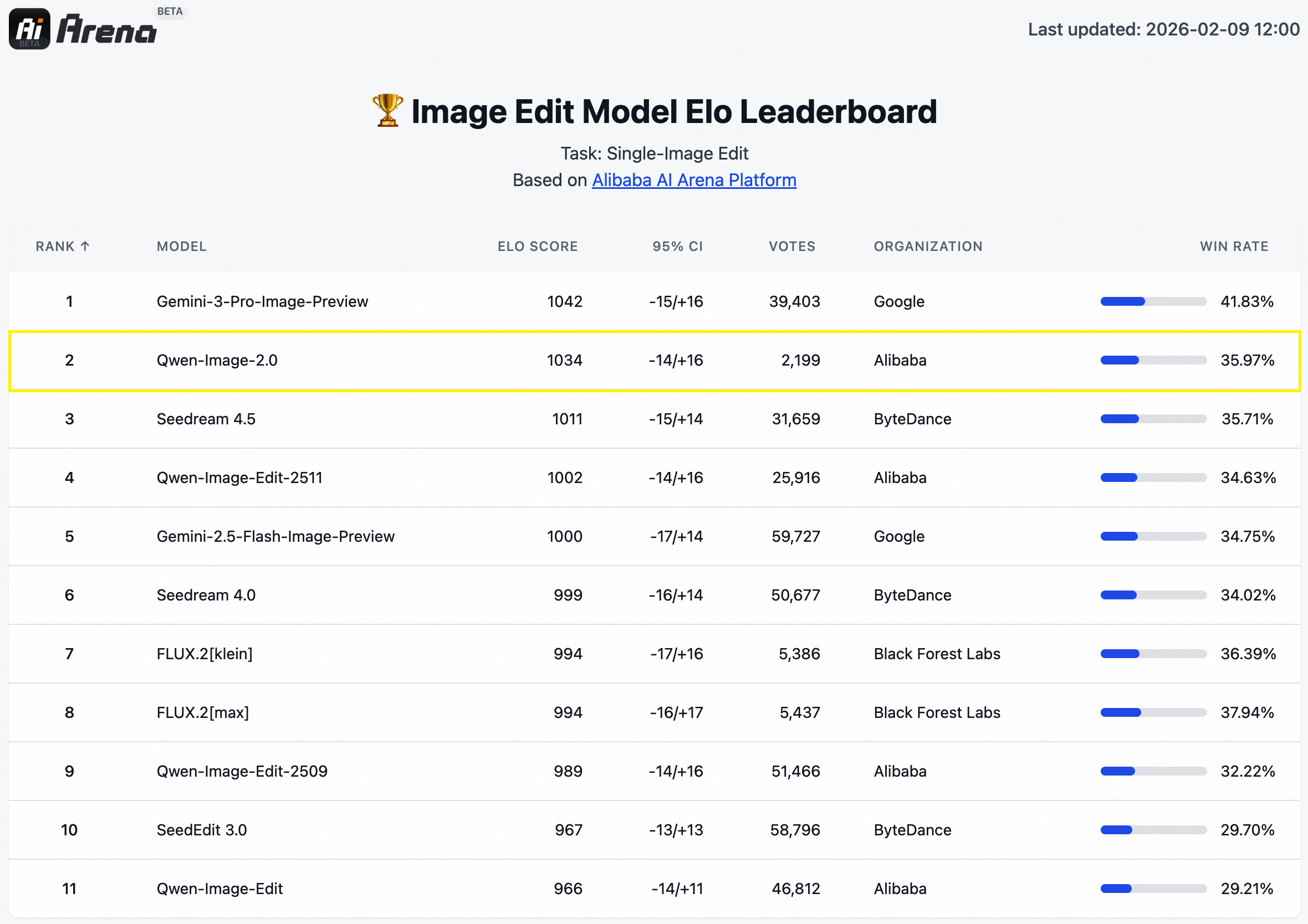

Während Google die Logik dominiert, greift Alibaba im kreativen Sektor an. Mit Qwen Image 2.0 wurde ein Modell veröffentlicht, das den bisherigen Platzhirschen wie Midjourney oder Googles eigenen Image-Modellen nicht nur Konkurrenz macht, sondern sie in entscheidenden Metriken überholt.

Die Ära der Omni-Modelle

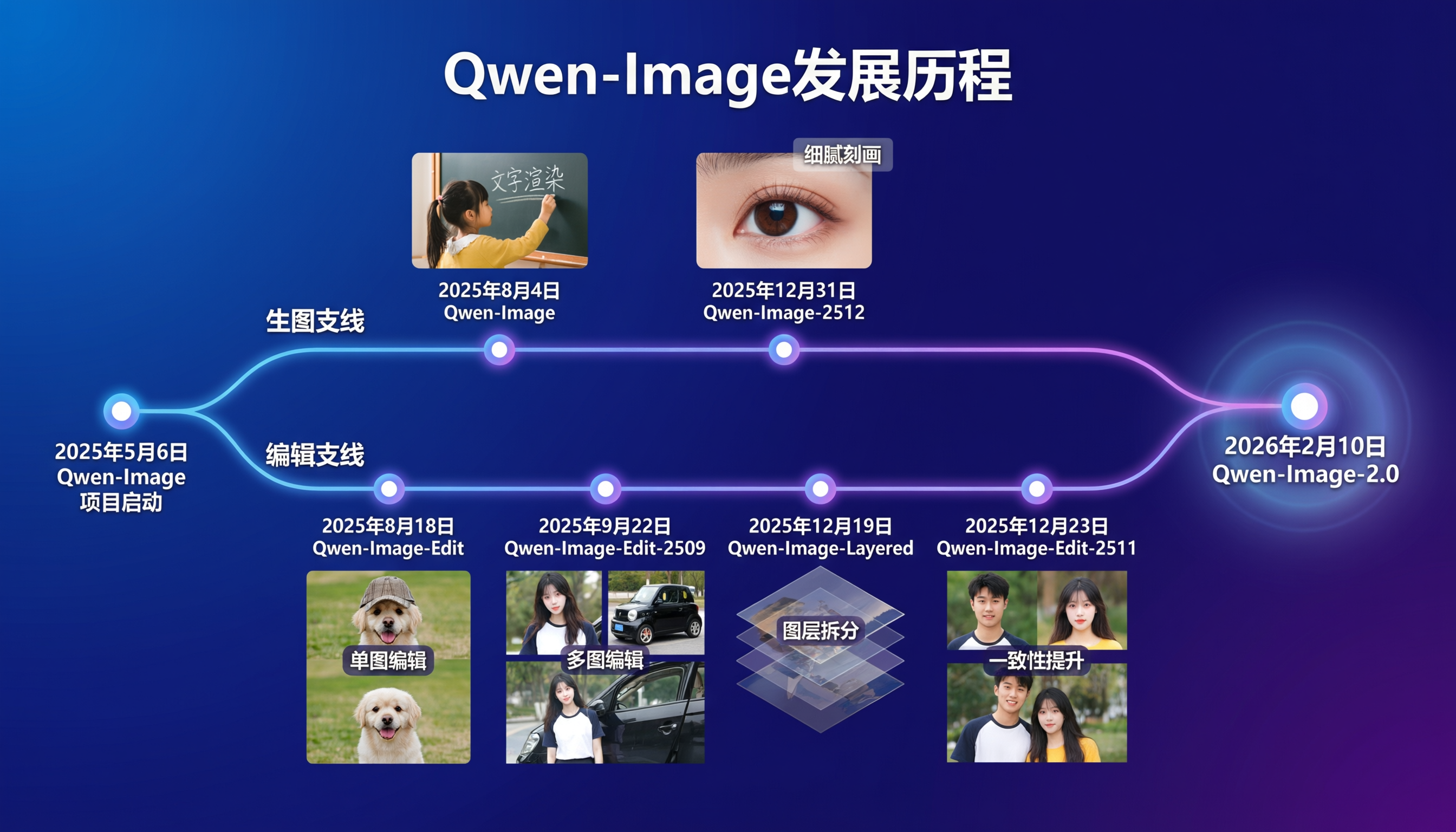

Das Besondere an Qwen Image 2.0 ist seine Architektur als „Unified Omni Model“. Es trennt nicht mehr strikt zwischen Generierung und Bearbeitung. Dasselbe Modell, das ein fotorealistisches Bild eines Pferdes erstellt, kann dieses Bild im nächsten Schritt verstehen, analysieren und pixelgenau editieren.

Die Benchmarks der Alibaba AI Arena sprechen eine deutliche Sprache. Im Bereich Text-to-Image hat sich Qwen Image 2.0 auf Platz 3 vorgekämpft, nur knapp hinter den spezialisierten Preview-Modellen von Google und OpenAI, aber mit einer entscheidenden Stärke: Konsistenz bei komplexen Prompts.

Noch beeindruckender ist jedoch die Performance bei der Bildbearbeitung (Image Editing). Hier lässt das Modell fast die gesamte Konkurrenz hinter sich. Die Fähigkeit, Texte in Bildern fehlerfrei zu rendern (z.B. komplexe Diagramme, Kalenderblätter oder Poster mit korrekter Typografie), ist auf einem Niveau, das Grafikdesigner nervös machen sollte.

Die Demonstration zeigte Diagramme mit drei Spalten, Flowcharts und Tabellen, die alle in einem einzigen Prompt spezifiziert und korrekt generiert wurden. Das ist das Ende von „Lorem Ipsum“ in AI-Bildern.

Minimax M2.5 & Der Preisverfall der Intelligenz

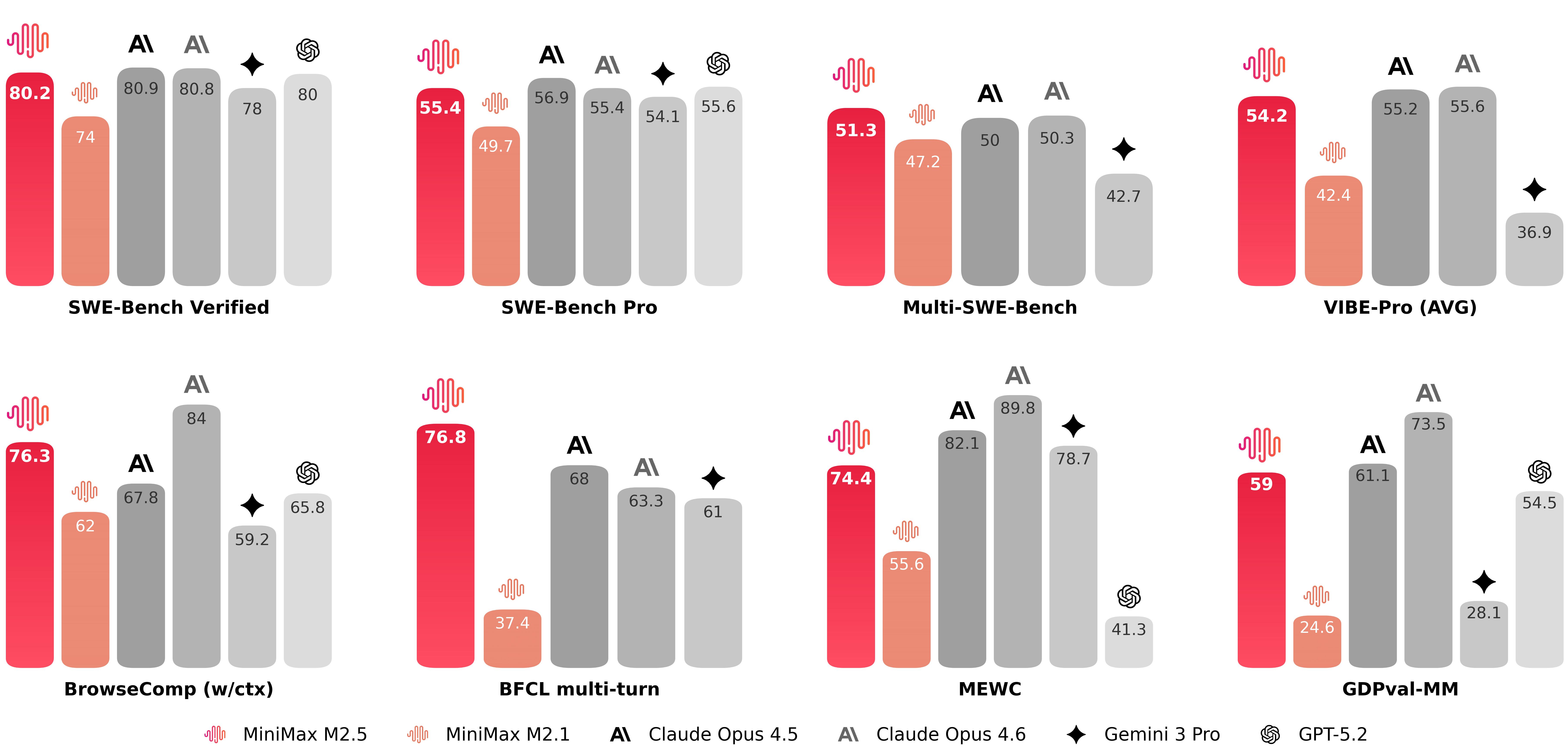

Vielleicht die wirtschaftlich bedeutsamste Nachricht der Woche kommt von Minimax. Mit dem Modell M2.5 wurde ein Frontier-Modell veröffentlicht, das die Ökonomie von KI-Anwendungen auf den Kopf stellt. Das Versprechen: Intelligenz ist jetzt so billig, dass man sie verschwenden kann.

Die $1-Revolution

Minimax wirbt damit, dass man das Modell für nur 1 USD pro Stunde kontinuierlich laufen lassen kann – bei einer Geschwindigkeit von 100 Token pro Sekunde. Das ermöglicht völlig neue Anwendungsfälle, bei denen Agenten im Hintergrund permanent arbeiten, Daten analysieren oder Code refactoring betreiben, ohne dass die Kosten explodieren.

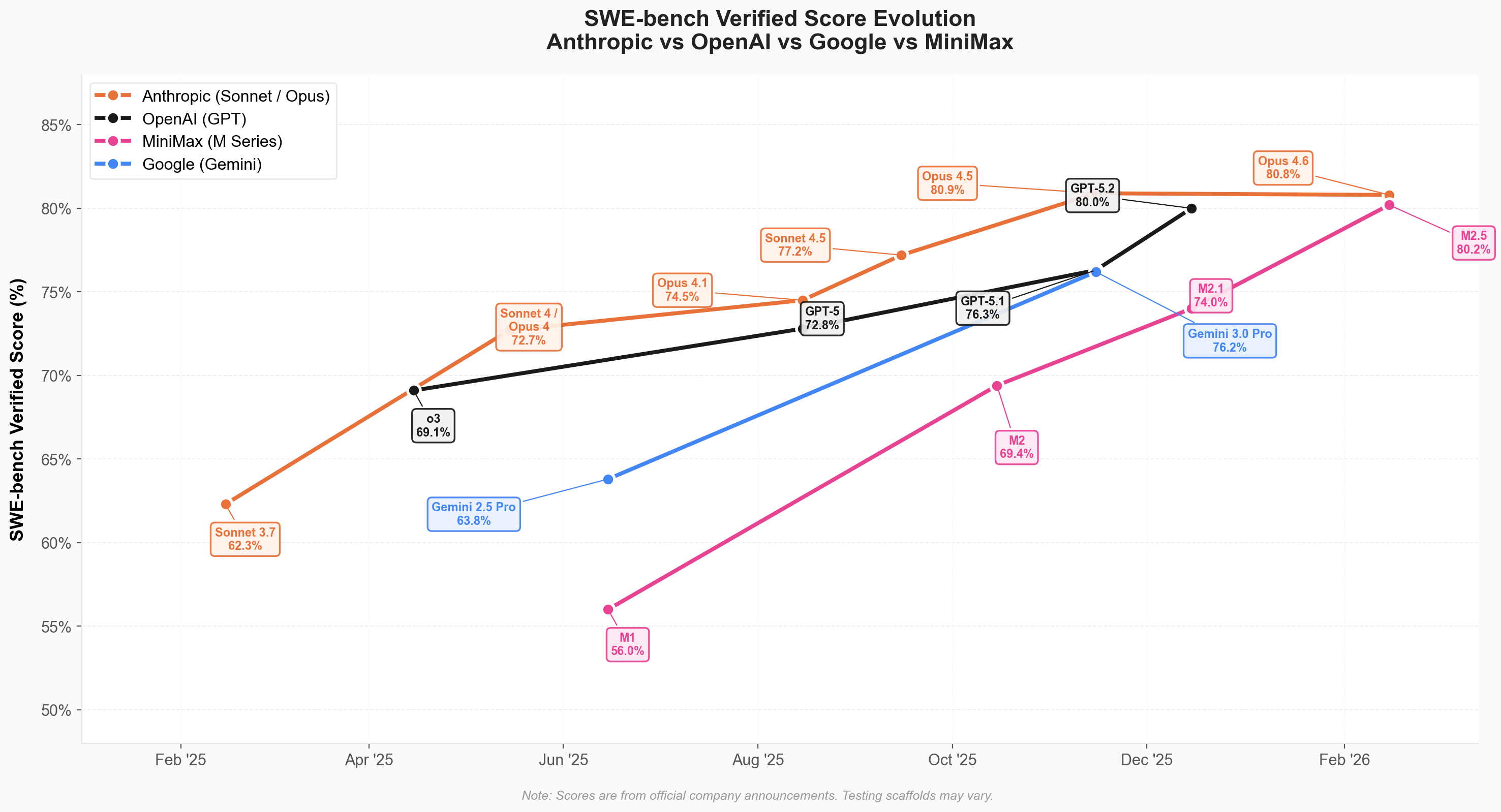

Im SWE-bench Verified (Software Engineering) sehen wir, dass M2.5 (Score: 80.2%) praktisch gleichauf mit GPT-5.2 (80.0%) und Claude Opus 4.6 (80.8%) liegt. Der Unterschied? Der Preis. Ein Entwicklerteam kann nun jedem Junior-Dev einen permanent laufenden AI-Pair-Programmer zur Seite stellen, der nicht nur Code vervollständigt, sondern komplexe Refactorings über Nacht autonom durchführt.

Die Demos zeigten beeindruckende Fähigkeiten im „Office Work“: Das Hochladen von Zip-Dateien mit hunderten Rechnungen, die in Sekunden in Excel-Tabellen verwandelt wurden, oder die Erstellung kompletter PowerPoint-Präsentationen im Corporate Design. Minimax positioniert sich hier klar als das „Arbeitspferd“ der KI-Industrie.

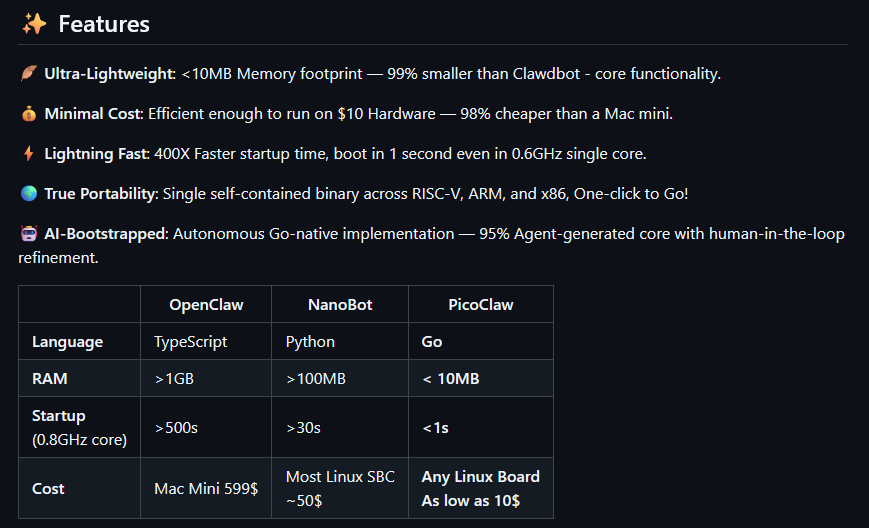

Die Demokratisierung der Agenten: PicoClaw

Während Minimax die Cloud-Kosten senkt, bringt PicoClaw die KI-Agenten auf lokale Kleinstgeräte. Wir haben alle von OpenClaw gehört, dem mächtigen, aber speicherhungrigen Framework. PicoClaw ist die Antwort für die Edge-Computing-Ära.

Mit einer Speicherbelegung von unter 10 MB und einer in Go geschriebenen Architektur läuft dieser Agent auf Hardware, die so günstig wie 10 Dollar ist (z.B. Raspberry Pi Zero Klone oder günstige RISC-V Boards). Das bedeutet:

- Lokale Intelligenz: Ihr Smart Home braucht keine Cloud mehr, um komplexe Automatisierungen zu verstehen.

- Geschwindigkeit: Boot-Zeiten von unter einer Sekunde ermöglichen „Instant-On“-KI-Assistenten.

- Privatsphäre: Da es lokal läuft, verlassen sensible Daten nie das eigene Netzwerk.

PicoClaw integriert sich nahtlos in Messenger wie Telegram oder WhatsApp und macht den eigenen Server zum persönlichen Sekretär, der 24/7 erreichbar ist, ohne die Stromrechnung in die Höhe zu treiben.

Physical AI: Wenn Code den Raum betritt

Diese Woche war nicht nur für Software ein Meilenstein. Die Robotik hat Sprünge gemacht, die wir so schnell nicht erwartet hätten. Der Begriff „Moravec’s Paradox“ (was für Menschen schwer ist, ist für Roboter leicht und umgekehrt) scheint sich langsam aufzulösen.

Robotero L7: Der Schwerttänzer

Vergessen Sie langsame, staksige Bewegungen. Der Robotero L7 demonstrierte einen Schwerttanz, der hohe Agilität, Balance und präzise Koordination erfordert. Dies ist kein vorprogrammierter Pfad in einer sterilen Laborumgebung, sondern eine Demonstration von Echtzeit-Physik-Berechnung.

Parallel dazu zeigte Westlake Robotics mit dem Titan01, wie VR-Teleoperation die Arbeit in Gefahrenzonen revolutionieren kann. Ein Operator steuert den Roboter über hunderte Kilometer Entfernung in Echtzeit – ideal für Minenräumung oder Katastrophenschutz.

ByteDance Seedance & Alive

Die Brücke zwischen physischer Bewegung und digitaler Generierung schlägt ByteDance mit Seedance 2.0. Die Generierung von Kampfszenen mit konsistenten Charakteren und physikalisch korrekten Bewegungen ist der heilige Gral der Videogenerierung. Zusammen mit dem neuen Modell Alive, das Audio und Video synchron generiert, sehen wir hier die Zukunft der Unterhaltungsindustrie.

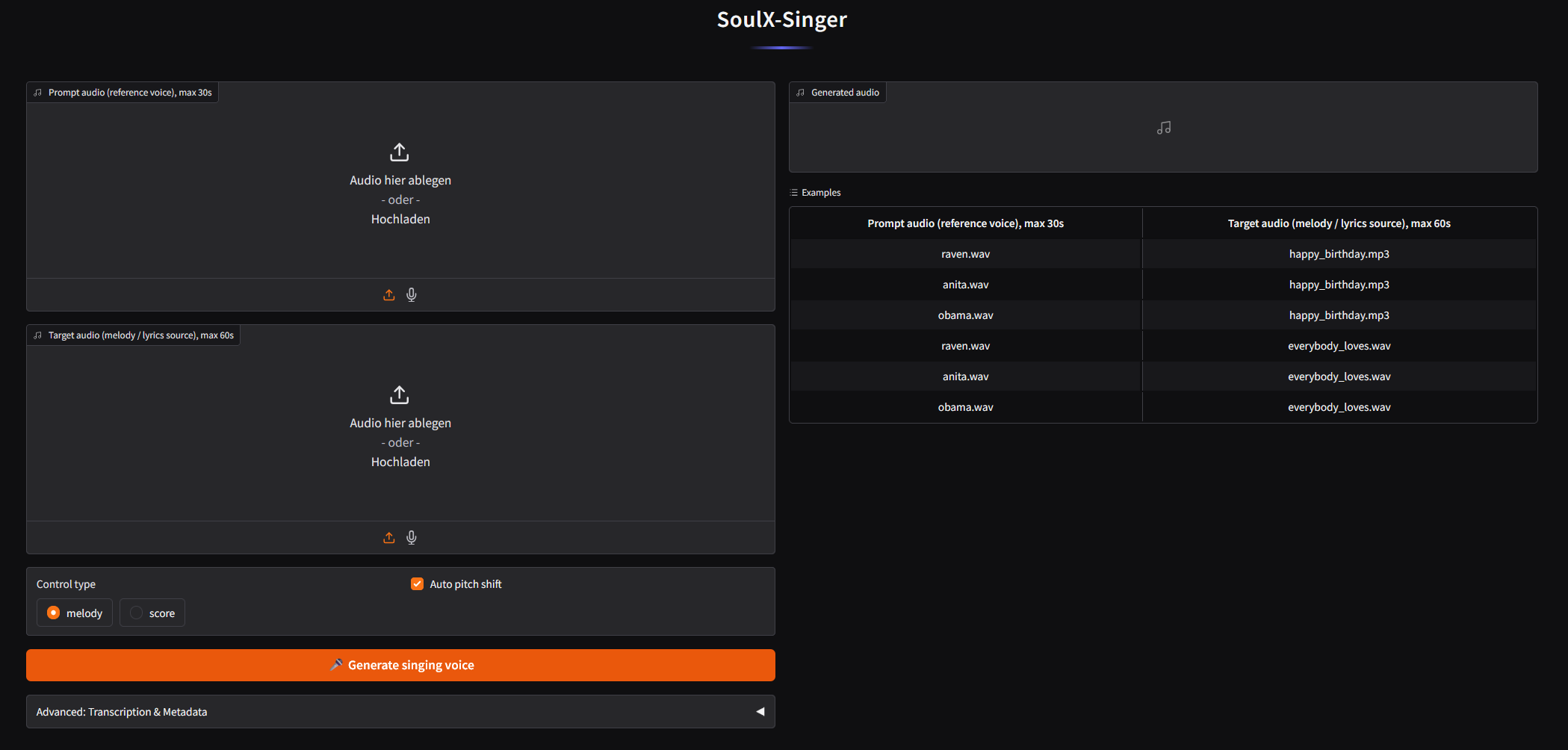

Kreative Synthese: SoulX Singer

Zum Abschluss noch ein Blick auf die Audio-Front. SoulX Singer hat gezeigt, dass Voice Cloning nun den „Singing“-Turing-Test bestanden hat. Die Möglichkeit, eine Sprechstimme (z.B. Obama oder die eigene Stimme) zu nehmen und sie beliebige Songs singen zu lassen – von Metal bis Rap – ist technisch faszinierend und urheberrechtlich explosiv.

Das Tool erlaubt nicht nur das Covern von Songs, sondern auch das Summen einer eigenen Melodie, auf die dann der Text mit der geklonten Stimme gelegt wird. Dies demokratisiert die Musikproduktion massiv: Wer nicht singen kann, aber komponieren will, hat nun das ultimative Werkzeug.

Fazit: Die Beschleunigung der Beschleunigung

Was sagt uns diese Woche im Februar 2026? Wir sehen eine Divergenz:

- High-End Reasoning (Gemini 3): Für die Lösung der großen wissenschaftlichen Probleme.

- Commodity Intelligence (Minimax, PicoClaw): Günstige, allgegenwärtige Intelligenz für den Alltag.

- Physical Embodiment (Robotero): Die KI lernt laufen.

Die Werkzeuge sind da. Die Kosten sinken. Die Barrieren fallen. Die Frage ist nicht mehr, ob eine KI etwas tun kann, sondern welches Modell für die spezifische Aufgabe am effizientesten ist – und ob wir schnell genug sind, diese Werkzeuge in unsere Workflows zu integrieren.

„Wir sind an dem Punkt, an dem wir nicht mehr programmieren, sondern orchestrieren.“

Aus der Community-Diskussion zu den neuen Releases