Wir schreiben den 8. Februar 2026, und wenn Sie dachten, die letzte Woche sei ruhig gewesen, dann haben Sie nicht aufgepasst. "KI schläft nie" ist längst kein bloßer Spruch mehr – es ist die Realität einer technologischen Singularität, die sich vor unseren Augen entfaltet. In den letzten sieben Tagen haben wir den wohl aggressivsten Schlagabtausch zwischen den Giganten Anthropic und OpenAI erlebt, den die Geschichte bisher gesehen hat, flankiert von einer Open-Source-Welle, die proprietäre Modelle zunehmend unter Druck setzt.

Willkommen zu einer der dichtesten Wochen in der Geschichte der künstlichen Intelligenz. Von Modellen, die sich selbst verbessern und ihren eigenen Code schreiben, bis hin zu Robotern, die Skateboard fahren – wir stehen an einem Punkt, an dem "Science Fiction" nur noch eine veraltete Bezeichnung für die Nachrichten von gestern ist. In diesem Deep Dive analysieren wir die monumentalen Veröffentlichungen von Claude Opus 4.6, GPT-5.3 Codex, GLM-OCR und vielen weiteren Durchbrüchen, die unsere Arbeitsweise fundamental verändern werden.

Der Kampf der Titanen: Claude Opus 4.6 vs. GPT-5.3 Codex

Es wirkt fast abgesprochen: Anthropic veröffentlicht sein bisher intelligentestes Modell, und nur wenige Minuten später kontert OpenAI mit einem spezialisierten Coding-Giganten. Doch lassen Sie uns die Details betrachten, denn die Nuancen entscheiden hier über die Vorherrschaft im Jahr 2026.

Claude Opus 4.6: Der neue Maßstab für Reasoning

Anthropic hat mit Claude Opus 4.6 ein Modell auf den Markt gebracht, das in Sachen reiner Intelligenz und Problemlösungskompetenz alles bisher Dagewesene in den Schatten stellt. Es ist nicht einfach nur ein weiteres Update; es ist ein massiver Sprung in der Fähigkeit einer KI, komplexe, nie gesehene Probleme zu lösen.

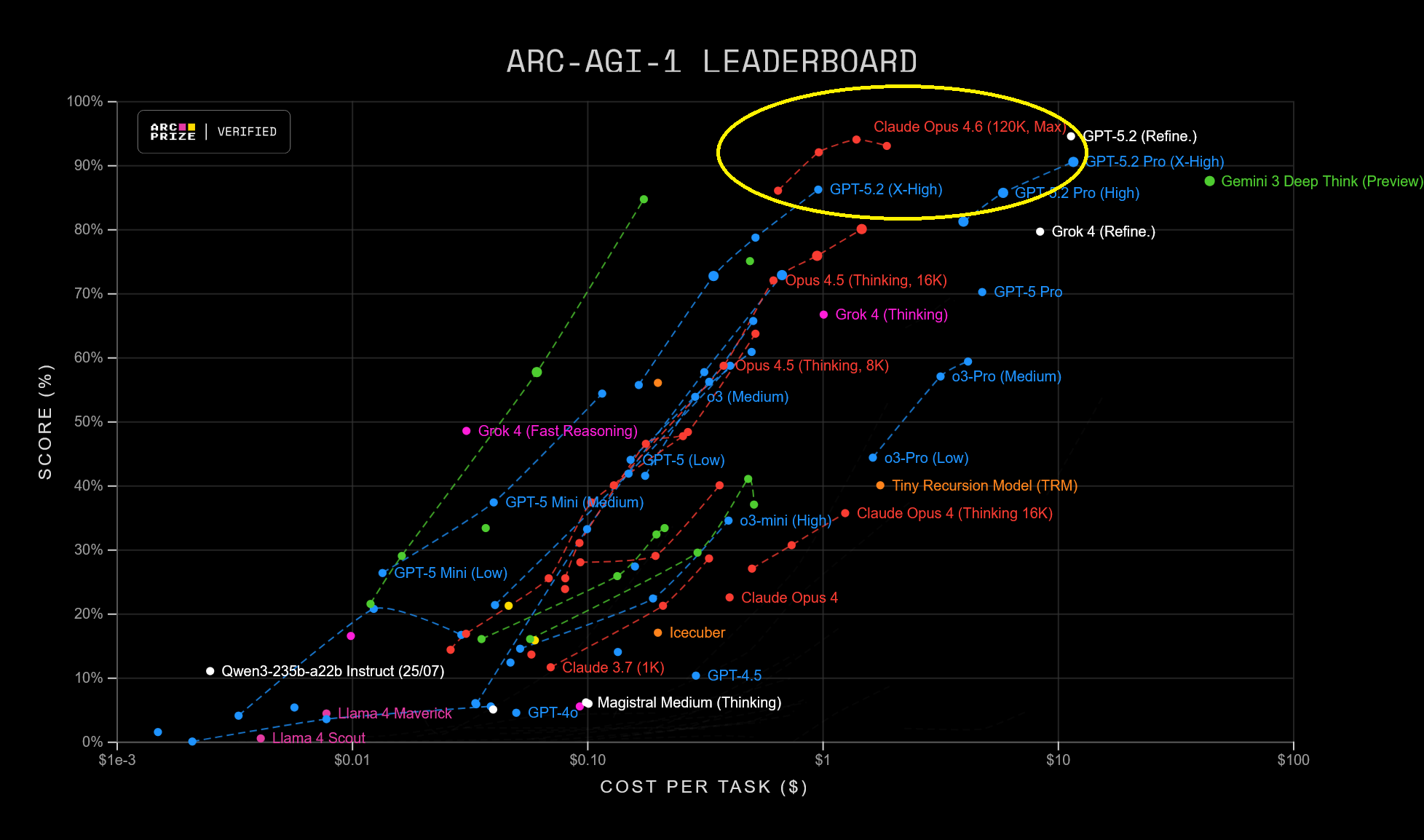

Besonders hervorzuheben ist die Leistung im ARC-AGI-2 Benchmark. Für diejenigen, die mit ARC (Abstraction and Reasoning Corpus) nicht vertraut sind: Dies ist der "Endgegner" der KI-Benchmarks. Es testet nicht auswendig gelerntes Wissen, sondern die Fähigkeit, völlig neue visuelle Muster zu erkennen und logische Regeln daraus abzuleiten – eine Fähigkeit, die lange Zeit als exklusive Domäne menschlicher Intelligenz galt.

Opus 4.6 erreicht hier fast 70%, ein Wert, der vor zwei Jahren noch als unerreichbar galt. Das bedeutet, dass das Modell nicht mehr nur Muster reproduziert, sondern versteht. In unabhängigen Bestenlisten wie der "LM Arena" und "Artificial Analysis" hat es sofort den ersten Platz eingenommen, sowohl im Coding als auch im allgemeinen Textverständnis, und verweist damit Gemini 3 Pro und GPT-5.2 auf die Plätze.

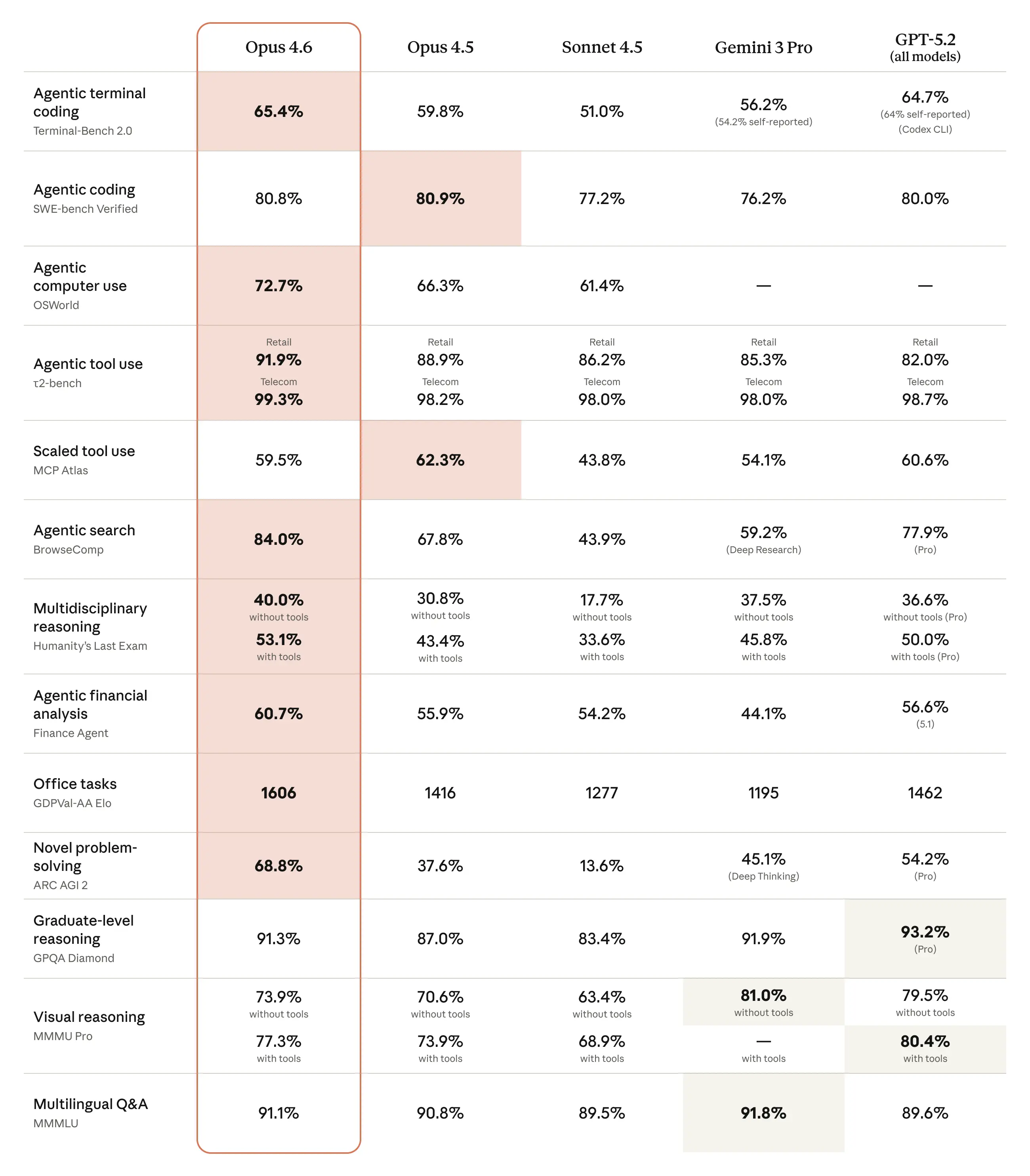

Benchmark-Analyse: Wo Opus glänzt

Ein Blick auf die technischen Daten offenbart eine Kuriosität: Während Opus 4.6 in fast allen Bereichen (Agentic Search, Multidisciplinary Reasoning) dominiert, schneidet es im spezifischen SWE-bench Verified (einem Standard für Software-Engineering) paradoxerweise etwas schlechter ab als sein Vorgänger Opus 4.5. Dies könnte auf eine Überoptimierung in Richtung "General Reasoning" hindeuten, bei der spezialisierte Coding-Routinen zugunsten breiterer Denkfähigkeit etwas in den Hintergrund getreten sind.

Dennoch: Mit einem Score von 91,9% bei "Graduate-level reasoning" (GPQA Diamond) zementiert Anthropic seinen Ruf als erste Anlaufstelle für wissenschaftliche und akademische Hochleistungsanwendungen.

GPT-5.3 Codex: Die rekursive Selbstverbesserung

Kaum hatte die Welt die Nachricht von Opus 4.6 verdaut, ließ OpenAI die Bombe platzen: GPT-5.3 Codex. Und hier wird es fast schon unheimlich. In den Release-Notes findet sich ein Satz, der in die Geschichtsbücher der Informatik eingehen könnte:

"GPT-5.3 Codex is the first model that was instrumental in creating itself. The Codex team used early versions to debug its own training, manage its own deployment, and diagnose test results."

OpenAI Release Notes, Feb 2026

Wir sprechen hier von rekursiver Selbstverbesserung. Das Modell hat geholfen, sich selbst zu erschaffen, Fehler im eigenen Trainingsprozess zu finden und die Entwicklung zu beschleunigen. Das Ergebnis ist der wohl fähigste autonome Coding-Agent, den wir je gesehen haben.

Im Gegensatz zu Opus 4.6, das ein Generalist ist, ist GPT-5.3 Codex ein Spezialist. Es schlägt Opus im Terminal Bench 2 deutlich. Das Modell kann komplexe Projekte autonom durchführen – vom Schreiben eines 3D-Rennspiels (wie im Bild oben zu sehen, komplett mit Kollisionsabfrage und Items) bis hin zur Erstellung ganzer PowerPoint-Präsentationen oder der Analyse von Finanzdaten in Excel.

Für Entwickler bedeutet dies: GPT-5.3 Codex ist der Mitarbeiter, der nachts nicht schläft. Es ist derzeit nur über die kostenpflichtigen ChatGPT-Pläne verfügbar, aber die API steht laut OpenAI kurz vor dem Rollout.

Open Source schlägt zurück: Lokale Giganten

Während die proprietären Modelle um die Krone kämpfen, passiert im Open-Source-Bereich etwas fast noch Wichtigeres: Die Demokratisierung dieser extremen Leistung. Wir müssen uns nicht mehr zwingend zwischen "gut" und "lokal" entscheiden.

Step 3.5 Flash & Quen 3 Coder Next

Zwei Modelle stachen diese Woche besonders hervor. Zum einen Step 3.5 Flash, ein "Mixture of Experts" (MoE) Modell. Mit rund 200 Milliarden Parametern (von denen aber nur 11 Milliarden aktiv pro Token genutzt werden), ist es effizient genug, um auf High-End-Consumer-Hardware oder kleinen Clustern zu laufen, bietet aber eine Reasoning-Leistung auf dem Niveau von Gemini 3 Pro.

Besonders beeindruckend ist die Generierungsgeschwindigkeit von 100 bis 300 Token pro Sekunde. Es eignet sich hervorragend für Deep Research und komplexe Simulationen, wie das Erstellen eines interaktiven Sonnensystems in Echtzeit-Code.

Zum anderen haben wir Alibabas Quen 3 Coder Next. Ein 80-Milliarden-Parameter-Modell, das speziell für agentisches Coding trainiert wurde. Es wurde mit über 800.000 "verifiable coding tasks" gefüttert – Aufgaben, bei denen das Modell lernen konnte, seine eigenen Fehler zu erkennen und zu korrigieren. Das Ergebnis ist ein Open-Source-Modell, das sich in Benchmarks wie SWE-bench Pro mit den ganz Großen messen kann, aber lokal betrieben werden kann (vorausgesetzt, man hat genügend VRAM, da selbst die quantisierte FP8-Version noch massiv ist).

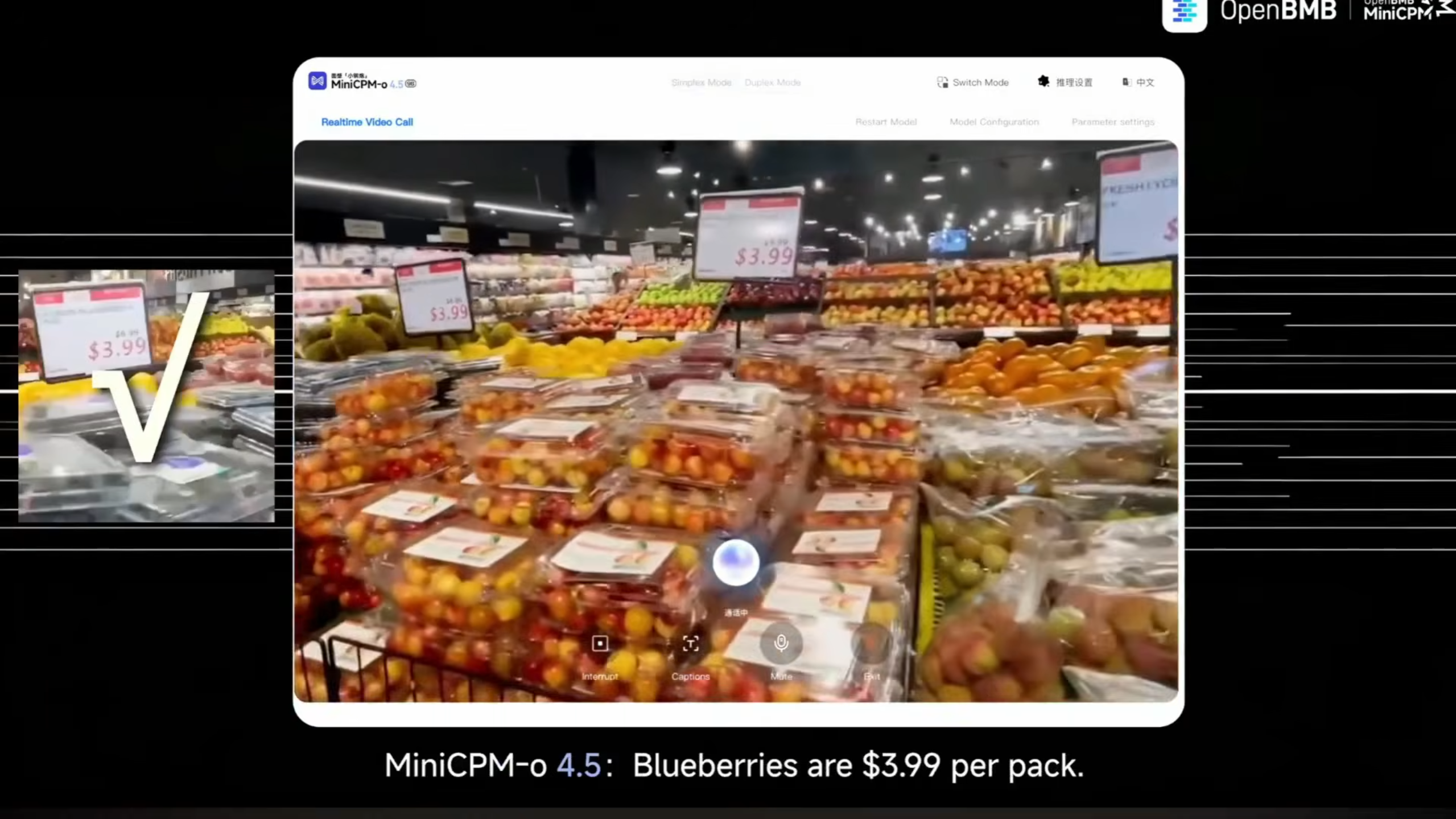

MiniCPM-o 4.5: Das omnimodale Wunder für die Edge

Vielleicht das beeindruckendste Stück Technik für den Endverbraucher ist jedoch MiniCPM-o 4.5. Während GPT-4o und Gemini Multimodalität in die Cloud brachten, bringt MiniCPM dies auf das Endgerät.

Mit nur 9 Milliarden Parametern ist dieses Modell klein genug, um auf einer modernen Grafikkarte (wie einer RTX 4090) oder sogar auf zukünftigen High-End-Smartphones zu laufen. Es ist "omnimodal" – es versteht Text, Bild, Audio und Video gleichzeitig.

- Echtzeit-Video-Verständnis: Sie können Ihre Kamera auf ein Regal im Supermarkt halten, und das Modell sagt Ihnen nicht nur, was Sie sehen, sondern vergleicht Preise oder liest Nährwerttabellen vor.

- Stimm-Mimikry: Es kann seine Stimme anpassen, um wie bestimmte Personas zu klingen (im Demo-Video wurde Elon Musk und die KI "Samantha" aus dem Film Her täuschend echt imitiert).

Die Tatsache, dass ein Modell dieser Leistungsfähigkeit open weights ist und lokal läuft, eröffnet völlig neue Anwendungsbereiche in der Privatsphäre-fokussierten Heimautomation und Assistenz.

Der visuelle Durchbruch: GLM-OCR und strukturelles Verständnis

Lange Zeit war OCR (Optical Character Recognition) eine langweilige, gelöste Technologie. Man dachte, Tesseract oder die Cloud-APIs von Google wären "gut genug". GLM-OCR von ZAI beweist das Gegenteil und definiert neu, was es heißt, ein Dokument zu "lesen".

Mehr als nur Text erkennen

Herkömmliche OCR-Systeme extrahieren Text oft als "Buchstabensuppe". Formatierungen, Tabellenstrukturen oder handschriftliche Notizen gehen verloren oder werden falsch interpretiert. GLM-OCR hingegen ist ein spezialisiertes Vision-Language-Model, das die Struktur versteht.

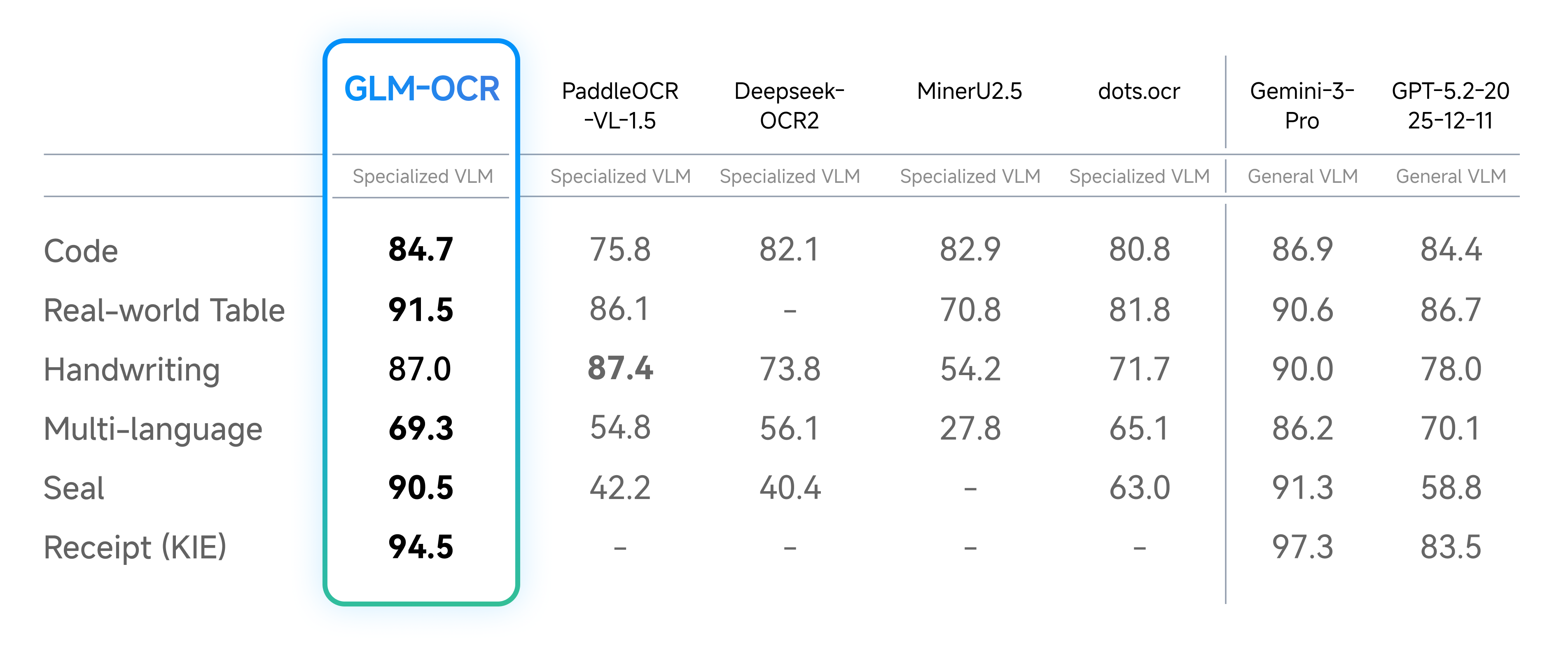

Wie die Benchmarks zeigen, übertrifft dieses Open-Source-Modell (nur 2,6 GB groß!) selbst proprietäre Giganten bei der Erkennung von komplexen Layouts.

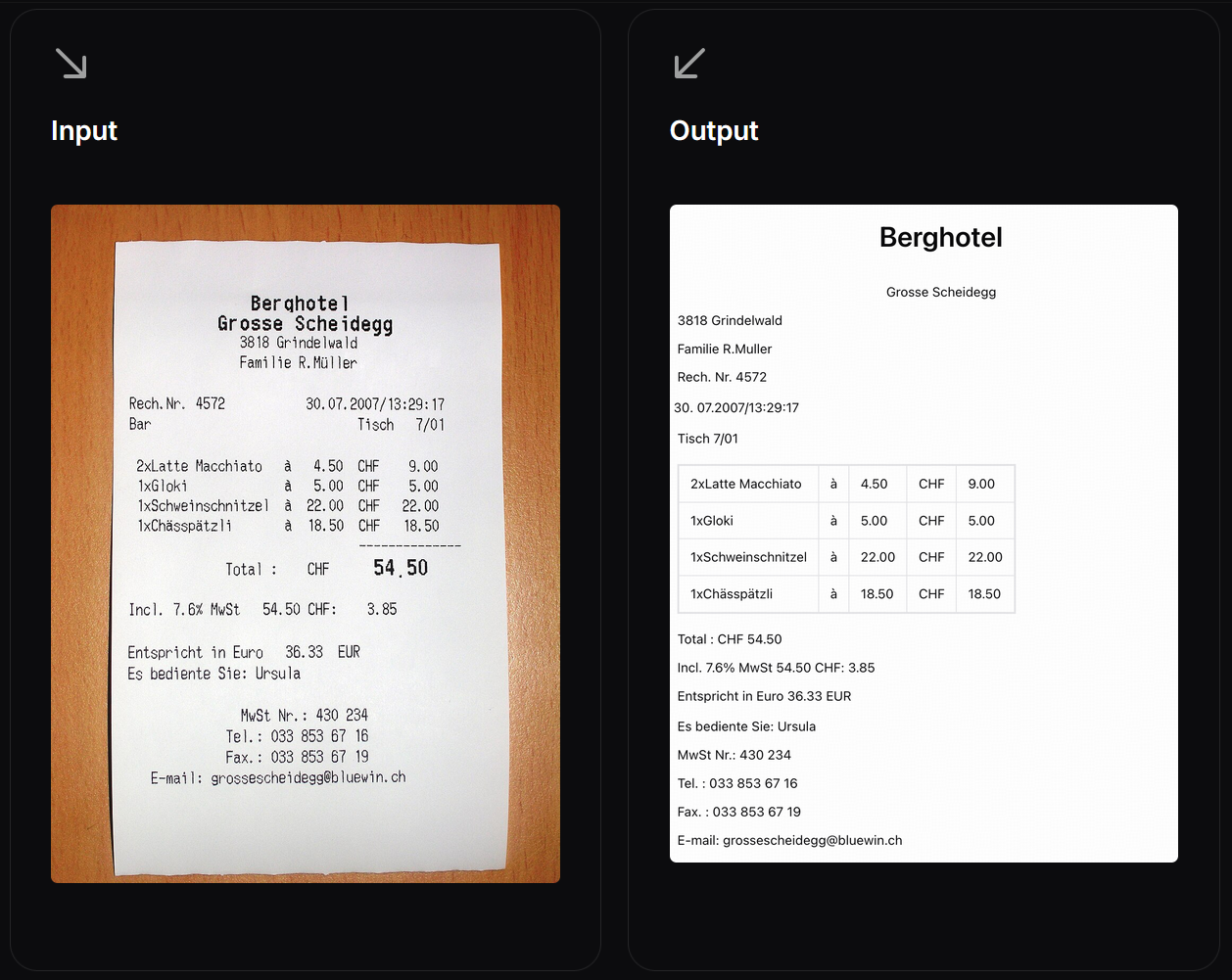

Beispiel 1: Der Kassenbon

Kassenbons sind der Albtraum jeder Buchhaltungs-KI: Zerknittert, schlechter Kontrast, seltsame Abkürzungen. GLM-OCR konvertiert ein Foto eines zerknitterten Schweizer Restaurantbelegs in eine perfekt strukturierte, digitale Repräsentation – nicht nur als Text, sondern als semantisch korrekte Tabelle.

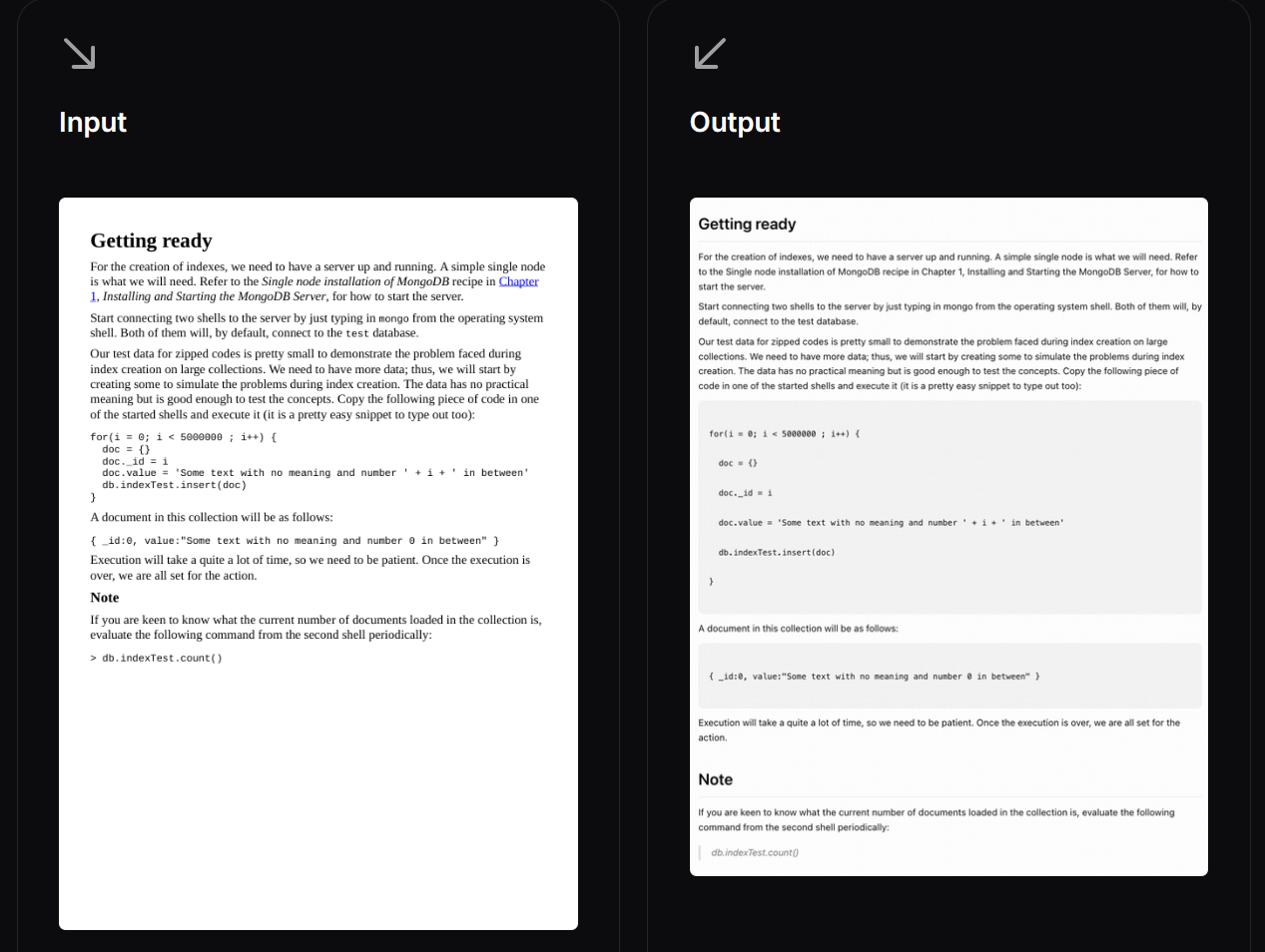

Beispiel 2: Code-Blöcke und Fachliteratur

Noch beeindruckender ist die Verarbeitung von Fachbüchern. Wer schon einmal versucht hat, Code aus einem PDF oder einem Foto eines Lehrbuchs zu kopieren, kennt das Problem: Einrückungen gehen verloren, Sonderzeichen werden falsch erkannt. GLM-OCR liefert hier ein Ergebnis, das direkt kompiliert werden könnte.

Das Modell ist bereits auf Hugging Face verfügbar und aufgrund seiner geringen Größe ein "No-Brainer" für jede lokale Pipeline zur Dokumentenverarbeitung.

Die nächste Dimension: 3D-Generierung und Animation

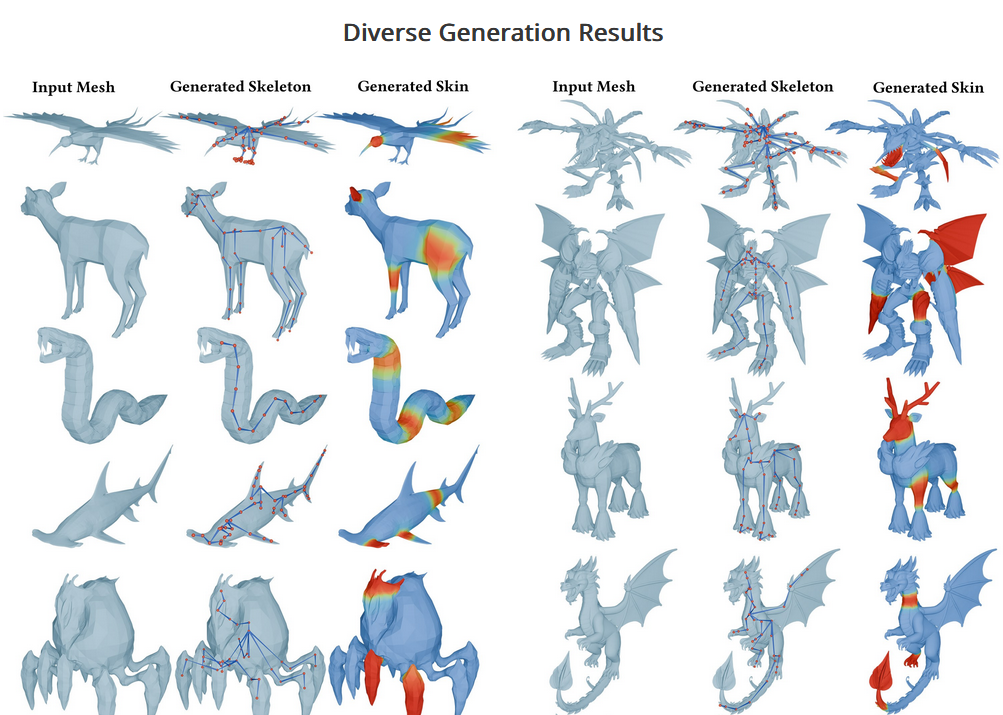

Wir bewegen uns weg von statischen Bildern und Videos hin zu vollständig interaktiven 3D-Assets. Ein großes Hindernis war bisher das "Rigging" – das Erstellen eines digitalen Skeletts, damit sich ein 3D-Modell bewegen kann. Das war Handarbeit für Profis.

SkinTokens: Das Skelett aus der Maschine

Mit SkinTokens wurde ein KI-Modell vorgestellt, das diesen Prozess automatisiert. Man füttert es mit einem statischen 3D-Mesh (egal ob Mensch, Drache, Stuhl oder abstraktes Wesen), und die KI generiert:

- Das Skelett (Bones).

- Die Gewichtung der Haut (Skinning weights), die bestimmt, wie sich die Oberfläche bei Bewegung verformt.

Dies ist ein Game-Changer für Indie-Entwickler und Animatoren. Die Demo zeigt, dass es selbst bei anatomisch unkonventionellen Kreaturen (wie einer Schlange oder einem sechsbeinigen Monster) physiologisch sinnvolle Skelette erstellt. In Kombination mit Motion-Transfer-Tools bedeutet das: Erstellen Sie ein Monster in Midjourney (als 3D-Objekt), lassen Sie es von SkinTokens riggen und übertragen Sie Ihre eigenen Webcam-Bewegungen darauf.

Weitere Highlights der Woche

Die Fülle an Innovationen macht es schwer, den Überblick zu behalten. Hier sind weitere Technologien, die diese Woche vorgestellt wurden und die Beachtung verdienen:

Video-Bearbeitung und "Edit Yourself"

Ein neues Tool namens Edit Yourself (derzeit in der Beta) erlaubt es, Videos so einfach wie Textdokumente zu bearbeiten. Sie haben sich im Video versprochen? Löschen Sie das Wort im Transkript, und die KI schneidet das Video – aber nicht mit einem harten Schnitt ("Jump Cut"), sondern durch visuelles Morphing. Noch extremer: Sie können Sätze hinzufügen, die Sie nie gesagt haben. Die KI generiert die passende Lippenbewegung und Stimmodulation. Ein Segen für Content Creator, ein Albtraum für die Authentizität von Medien.

Roboter im Extremtest

Unitree hat seinen G1-Roboter bei -47°C in China 130.000 Schritte machen lassen. Er fiel nicht aus. Parallel dazu stellten Forscher "Husky" vor, ein Framework, das Robotern das Skateboardfahren beibringt. Warum Skateboard? Weil es eines der physikalisch anspruchsvollsten Szenarien für Balance und Echtzeit-Reaktion ist. Wenn ein Roboter skaten kann, kann er auch auf einer öligen Bohrplattform oder in einem Erdbebengebiet sicher navigieren.

Paper Banana

Google stellte (etwas leiser) Paper Banana vor. Ein spezialisiertes Tool für Wissenschaftler, das aus Rohdaten druckreife, ästhetisch ansprechende Diagramme und Illustrationen für akademische Paper erstellt. Es nutzt einen Multi-Agenten-Ansatz (Kritiker, Designer, Daten-Analyst), um Grafiken zu iterieren, bis sie perfekt sind.

Fazit: Die Beschleunigung der Beschleunigung

Was wir in der Woche vom 8. Februar 2026 gesehen haben, ist keine lineare Entwicklung mehr. Wenn KIs wie GPT-5.3 Codex beginnen, sich selbst zu verbessern, verlassen wir den Bereich der klassischen Softwareentwicklung. Für Unternehmen und Entwickler heißt das: Adapt or die. Wer heute noch manuelle OCR betreibt oder 3D-Modelle von Hand riggt, verschwendet Ressourcen.

Die Verfügbarkeit von Modellen wie MiniCPM-o und Quen 3 Coder zeigt aber auch, dass diese Macht nicht nur in den Händen weniger US-Konzerne liegt. Die Open-Source-Community hält Schritt, oft effizienter und datenschutzfreundlicher.

Die Werkzeuge sind da. Die Frage ist nur: Was werden Sie damit bauen?

Dieser Artikel basiert auf den aktuellen Entwicklungen und Analysen aus dem YouTube-Video "Opus 4.6, GPT 5.3 Codex, StepFun... AI NEWS"